- Share this article

- Abonnez-vous à notre newsletter

ERC et développement rural – une abondance d’opportunités

Un essai randomisé contrôle (ERC) est un exemple de modèle d’évaluation d’impact parmi d’autres dont l’objet explicite est une analyse d’attribution. De fait, l’expression évaluation d’impact est trompeuse car elle pourrait donner à penser qu’il s’agit de modèles qui mesurent exclusivement des indicateurs d’impact. Il serait plus approprié d’appeler les évaluations d’impact évaluations contrefactuelles ou analyses d’attribution. Toutefois, attribuer un effet (qu’il s’agisse d’une réalisation, d’un résultat ou d’un impact) à une intervention suppose que tous les autres facteurs extérieurs à l’intervention, mais qui pourraient également avoir une incidence sur le résultat, restent constants (ou, dans le jargon, soient « contrôlés »). Dans l’environnement rural, les facteurs types ayant besoin d’être contrôlés sont la saison, les conditions météorologiques, l’accès aux marchés ou la distance qui en sépare, et les prix du marché.

Une analyse « Avec, plutôt que sans »

Comment les évaluations d’impact, et plus particulièrement les ERC, contrôlent-elles la différence faite par un programme ou une intervention ? Est-ce que ce programme ou cette intervention a entraîné des améliorations mesurables d’un quelconque point d’intérêt, qu’il s’agisse de l’utilisation de latrines en Inde rurale, de l’augmentation des revenus grâce à l’assurance indexée aux conditions météorologiques en Tanzanie, ou de l’autonomisation accrue des femmes grâce à l’argent mobile (services financiers numériques) dans le nord de l’Ouganda. L’évaluation d’impact est une analyse « avec, plutôt que sans » : que s’est-il passé avec le programme (élément factuel) comparativement à ce qui se serait produit en l’absence du programme (élément contrefactuel) ?

La plupart des agences de développement produisent des rapports sur la réalisation et les résultats au moment de la clôture du projet, sinon plus tôt. Pourquoi induisent-ils généralement en erreur lorsqu’il s’agit de résultats ? Ces rapports s’en remettent généralement uniquement aux informations et aux données de suivi fournies par le programme et sont ainsi fréquemment victimes de l’erreur « avant-après ». Envisagez de mesurer un résultat à la fois avant le démarrage d’un programme et un certain temps après sa mise en œuvre.

Généralement, en cas d’amélioration, le responsable du programme considère que l’intervention a été une réussite. Mais sur la durée d’un programme, de nombreux autres facteurs entrent en jeu, et notamment les autres programmes mis en œuvre dans le même pays. Sans un contrefactuel valide, il n’est pas possible de savoir si l’amélioration peut être attribuée aux activités du programme ou si elle aurait été la même malgré tout. Par ailleurs, dépenser de l’argent pour quelque chose ou mener une quelconque activité a un effet positif dans bien des cas : si des agriculteurs suivent une formation sur une nouvelle technique d’irrigation semi-automatique, quelques-uns d’entre eux, au moins, changeront leur façon de faire et auront de meilleurs rendements. Mais était-ce là le moyen le plus efficace et efficient d’accroître les rendements ou bien une formation sur l’amélioration de l’irrigation traditionnelle aurait-elle pu donner de bien meilleurs résultats ? Mais à défaut d’amélioration mesurable, il se pourrait bien que le programme ait servi de filet de sécurité si, par exemple, le même résultat avait empiré dans le reste du pays.

Une tâche difficile

Lors de la conception d’une évaluation d’impact, il est important de commencer par réfléchir à ce qu’on sait déjà (pas besoin de réinventer la roue), aux questions importantes auxquelles les responsables de la mise en œuvre du programme et la communauté élargie du développement veulent une réponse (sont-ils intéressés par l’efficacité ?) ainsi qu’aux délais et aux ressources disponibles. Les ERC nécessitent beaucoup de données et sont par conséquent relativement coûteux (mais pas nécessairement plus que d’autres modèles).

Concevoir un ERC « sous-motorisé », dont la taille de l’échantillon est trop faible pour détecter des effets statistiquement significatifs, n’est certainement pas un moyen efficace d’utiliser les ressources. Si, comme cela continue malheureusement d’être essentiellement le cas dans les programmes de développement, nous ne savons toujours pas si le type de programme/ d’intervention ou une sous-activité de l’un ou de l’autre « fonctionne » ou a d’importants effets secondaires néfastes, une évaluation d’impact peut être nécessaire. Mais il faut garder à l’esprit que selon les effets recherchés, ces aspects peuvent mettre du temps à émerger et être discernables dans les données.

Pour donner un exemple, il faut au moins un an pour détecter les effets sur la productivité agricole (prochaine saison de récolte de même type), alors que pour connaître l’effet des interventions de développement de la petite enfance sur l’employabilité, il faut une génération (15–20 ans). Une fois qu’il a été établi qu’une analyse contrefactuelle est nécessaire, la question suivante à examiner est de savoir comment élaborer un contrefactuel qui imite le mieux la population ciblée par l’intervention, tout en tenant compte de ce qui est éthique et faisable dans ce contexte particulier.

Spécificités du contexte rural

Il existe un certain nombre de variantes d’ERC qui se distinguent les unes des autres par l’unité de randomisation, la règle appliquée pour affecter la population au traitement ou au contrôle, et la façon dont le traitement est attribué ou espacé dans le temps. Chacun de ces facteurs sera présenté en prenant un exemple dans le domaine du développement rural. Il est intéressant de noter que dans les bases de données de l’Initiative internationale pour les évaluations d’impact (3ie), on trouve un grand nombre d’ERC dans l’espace rural.

À en croire notre expérience, trois points distinguent les ERC ruraux des ERC urbains. D’une part ils sont plus faciles à mettre en œuvre dans le contexte rural, les menaces de contamination étant relativement limitées en raison de la faible transmission de l’information, qui se limite généralement au village. D’autre part, deux points peuvent être la source de complications dans le contexte rural : premièrement, les réponses aux questions d’enquête risquent d’être plus exposées à divers types de biais (par ex. biais de désirabilité sociale), deuxièmement, selon le type d’intervention, l’échantillonnage risque d’être plus compliqué dans la mesure où les villages ou exploitations agricoles sont souvent situés dans des zones ou le microclimat, la qualité du sol et l’accès à l’eau sont particuliers et difficiles à détecter et mesurer. Au Rwanda, par exemple, deux villages apparemment identiques peuvent être situés dans des vallées séparées, à cinq kilomètres l’un de l’autre, et malgré tout exposés à des conditions climatiques très différentes. Dans la région rurale voisine de Cochabamba (Bolivie), la qualité du sol d’un côté de la route peut être très différente de la qualité du sol de l’autre côté de la route.

Les ERC en pratique

Une étude en cours financée par la 3ie utilise la randomisation individuelle pour examiner l’impact d’un produit financier hybride d’atténuation des risques associant crédit et assurance, appelé Risk Contingent Credit (RCC), au Kenya rural. 1 500 ménages ont été désignés de façon aléatoire pour recevoir un de ces trois traitements – (1) l’ERC, (2) un crédit traditionnel et (3) aucun crédit. La randomisation s’est faite au moyen d’une loterie publique au niveau du village ; les villageois étaient donc au courant du traitement dont chaque participant faisait l’objet. La randomisation individuelle est relativement peu coûteuse dans la mesure où les exigences concernant la taille de l’échantillon sont moindres. Toutefois, une randomisation de ce type dans un village est confrontée à des menaces pour la validité interne.

Le premier problème, à savoir celui de la contamination selon lequel des particuliers « échangent » leur situation de crédit, a été résolu en faisant en sorte que les contrats d’assurance/crédit ne soient pas cessibles. L’autre risque majeur, celui qu’on appelle l’effet John Henry, est associé au changement de comportement du groupe témoin qui, lorsqu’il sait ce qui se passe dans le groupe de traitement, décide de chercher un crédit traditionnel auprès d’autres banques opérant dans la région. L’équipe de recherche peut ne pas être en mesure de contrôler ce phénomène, mais en recueillant des informations sur le crédit et la source de l’emprunt elle peut identifier et évaluer l’ampleur du problème.

Le deuxième type d’exemple est celui de la randomisation par cluster, un cluster étant un groupe d’individus ou de ménages à un niveau qui a un sens du point de vue de l’intervention et du résultat recherché (par ex. village, écoles, établissements médicaux). De nombreuses interventions sont mises en œuvre, par exemple, au niveau de la communauté/du village et les avantages attendus doivent également être enregistrés à ce niveau, ce qui nécessite une randomisation par village plutôt qu’une randomisation par individu. L’autre raison d’une approche par cluster tient à l’important effet de retombées attendu dans les communautés rurales très soudées, phénomène selon lequel d’autres personnes d’une communauté dont certains membres participent à un programme peuvent également bénéficier de l’intervention (par ex. en observant leurs voisins et en leur parlant).

La 3ie finance quatre évaluations d’impact en cours mettant l’accent sur l’utilisation des latrines par les ménages ruraux dans quatre États indiens différents. Comme les quatre projets sont des interventions complexes comportant des démonstrations sociales, des ateliers, des activités communautaires et des communications dans différents médias, il y a un risque élevé d’effets de retombées des interventions sur les personnes et les ménages dans les zones concernées. En conséquence, les quatre projets ont adopté une approche d’ERC par cluster afin d’éviter ces effets. L’équipe de l’Odisha a randomisé au niveau du village alors que celle du Karnataka randomise au niveau du Gram Panchayat (le conseil de village, qui est l’unité administrative de premier niveau dans les zones rurales). Les projets ont choisi de randomiser à différents niveaux compte tenu des différences de distance.

Les exemples précédents ont tous été préparés pour répondre à la question « est-ce que le programme fonctionne ? » en ayant recours à des groupes témoins qui n’en bénéficient pas. Très souvent, toutefois, ce qu’on veut tester, ce sont des modifications apportées à un programme existant pour voir si l’ajout d’un élément de conception entraîne une amélioration de l’efficacité ou si la comparaison de différents ajouts permet de déterminer l’innovation la plus efficace. C’est dans ce contexte que se déroule actuellement un ERC à plusieurs volets financé par la 3ie pour tester des modules innovants de services de vulgarisation auprès des agriculteurs et leurs effets sur la productivité agricole au Cambodge, dans le cadre du projet de développement agricole et d’autonomisation économique (Project for Agricultural Development and Economic Empowerment – PADEE).

Les auteurs étudient l’impact de deux caractéristiques supplémentaires du modèle de vulgarisateur traditionnel qui donnent des conseils agricoles. Premièrement, ils évaluent l’impact de l’intégration des technologies de l’information et de la communication (TIC) pour compenser les faibles niveaux d’éducation et de formation techniques des agents de vulgarisation. Ces derniers reçoivent des tablettes équipées de logiciels spécialisés donnant des informations sur l’analyse du sol, les semences recommandées, l’application d’engrais et l’identification et le traitement des maladies des cultures agricoles.

Deuxièmement, les auteurs cherchent à savoir si les incitations basées sur les résultats peuvent encourager les agents de vulgarisation à exploiter les informations fournies par le logiciel pour améliorer leur efficacité. Les auteurs évaluent les impacts de ces caractéristiques en affectant de manière aléatoire 20 villages à chacun des volets de traitement suivants : 1) services de vulgarisation ordinaires, 2) vulgarisation par les TIC, et 3) vulgarisation par les TIC plus incitations. En mesurant la valeur ajoutée des composantes 2) et 3), ils comparent l’effet du deuxième traitement à celui du premier et celui du troisième à ceux du deuxième et du premier.

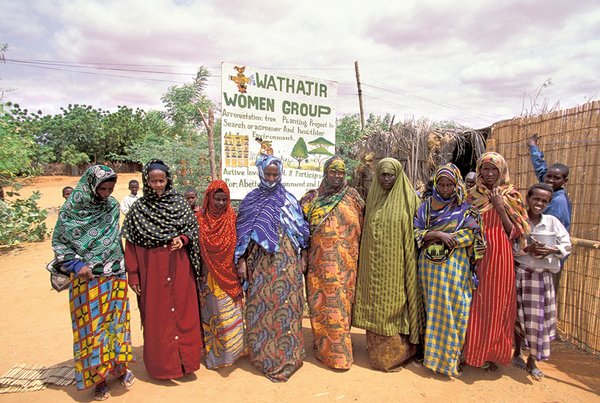

Parfois, les responsables de la mise en œuvre d’un programme cherchent à savoir si le dosage d’un traitement influe sur le résultat mesuré. Les essais randomisés par cluster et par étapes permettent de contrôler les variations dans le temps dues au chevauchement aléatoire et séquentiel de clusters, du contrôle à l’intervention. Au Soudan, une évaluation d’impact soutenue par la 3ie évalue l’impact de différents traitements MAM (malnutrition aigüe modérée) et de différentes interventions de prévention sur l’incidence et la prévalence de la malnutrition aigüe modérée chez les enfants de moins de cinq ans, les femmes enceintes et les femmes allaitantes. Le modèle d’évaluation utilise la variation dans le temps de l’introduction des composantes de prévention MAM (par exemple prévention en matière d’alimentation, communication sur le changement de comportement) et la supplémentation à domicile dans les localités (clusters) où les activités de traitement étaient en cours. Les impacts sont évalués par comparaison transversale de tous les clusters, et par comparaison dans le temps dans un même cluster. C’est-là un bon exemple de la méthodologie pouvant être utilisée pour une analyse causale fiable lorsqu’on ne dispose pas de données fondamentales et lorsque refuser d’appliquer le programme à tout groupe de bénéficiaires potentiels n’est ni souhaitable ni faisable.

Consicérations éthiques

Il est parfois mal perçu que les modèles d’évaluation d’impact exigent que seulement quelques personnes bénéficient de l’intervention, et cela nous amène à des questions d’éthique. Toutefois, la randomisation n’implique pas nécessairement que seuls quelques individus bénéficient d’une intervention ; elle est particulièrement bien adaptée lorsque, pour des raisons financières ou logistiques, la mise en œuvre ou le déploiement est lent ou décalé ou lorsque des groupes comparables sont exclus pour d’autres raisons. C’est la réalité de la plupart des interventions de développement.

Le principe selon lequel l’affectation à un groupe de comparaison ou un groupe témoin implique de « ne rien recevoir en retour » sous-tend en partie les problèmes d’éthique associés aux évaluations d’impact. Ce n’est pas nécessairement le cas pour deux raisons. Premièrement le groupe de comparaison peut recevoir un traitement avec lequel une autre intervention concurrente est comparée, comme nous l’avons vu avec l’ERC à plusieurs volets. Deuxièmement, il est important d’examiner l’hypothèse selon laquelle recevoir une intervention de développement, ou plus d’une, est toujours un avantage. La réalité est que l’efficacité et l’impact d’un grand nombre d’interventions restent à prouver. En cas de réelle incertitude sur les avantages d’une intervention, incertitude selon laquelle elle pourrait théoriquement être néfaste ou inefficace, il est urgent de l’examiner d’un œil critique. Ce niveau d’incertitude est appelé « équilibre » dans la documentation médicale.

D’autre part, lorsqu’un programme ne peut être immédiatement mis en œuvre auprès de tous les individus, la randomisation des bénéficiaires peut être perçue comme plus éthique et transparente que tout autre mécanisme de sélection. Si les questions d’éthique peuvent parfois être déplacées ou exagérées pour les raisons que nous venons d’évoquer, il n’en est pas moins très important de toujours bien tenir compte des questions d’éthique potentielles pouvant être soulevées lorsqu’on prépare et réalise des ERC.

En résumé, le manque de connaissances sur ce qui fonctionne, quand et où, dans l’espace de développement rural et agricole (consulter la carte des lacunes en matière de preuve – Evidence Gap Maps – de la 3ie) reste considérable et les possibilités d’utiliser les évaluations d’impact du type ERC pour répondre aux questions d’efficacité sont très nombreuses.

Marie M. Gaarder est directrice du bureau d’évaluation et directrice mondiale de l’innovation et de l’engagement des pays pour l’Initiative internationale pour les évaluations d’impact (3ie). Elle a également occupé des postes de cadres supérieurs à la Banque mondiale et à l’Agence norvégienne de coopération au développement. Marie Gaarder est titulaire d’un doctorat en économie de l’University College de Londres.

Contact: mgaarder@3ieimpact.org

Sven Harten dirige le centre de compétence des méthodologies d’évaluation et est directeur adjoint de l’Institut allemand d’évaluation du développement (DEval). Il compte plus de 15 années d’expérience comme évaluateur professionnel et a récemment travaillé comme spécialiste de l’évaluation à la Banque mondiale (SFI). Sven Harten est titulaire d’un doctorat en science politique de la London School of Economics.

Contact: sven.harten@deval.org

Avec la participation de Bidisha Barooah, Neeta Goel, Shaon Lahore, Diana Lopez-Avila, Emmanuel Jimenez, Monica Jain, Tara Kaul, et Francis Rathinam.

Références

Gaarder, M. M. and J. Annan (2013), Impact Evaluation for Peacebuilding: challenging preconceptions, in Winckler, O., Kennedy-Choane, M. and B. Bull (eds.), Evaluation methodologies for aid in conflict, Routledge.

Gaarder, M. M. and J. Annan (2013), Impact Evaluation of Conflict Prevention and Peacebuilding Interventions, Policy Research Working Paper 6496, the World Bank, June 2013.

Gaarder, M. and U. Bartsch (2015), Creating a Market for Outcomes: Shopping for Solutions, Journal of Development Effectiveness, 7:3, 304-316.

White, H. (2009), Some reflections on current debates in impact evaluation, 3ie Working Paper no.1.

White, H. (2013), An introduction to the use of randomized control trials to evaluate development interventions, 3ie Working Paper no.9.

3ie’s Evidence Repositories

http://www.3ieimpact.org/en/evidence/

3ie’s Evidenca Gap Maps

http://3ieimpact.org/en/evidence/gap-maps/

3ie study on the impacts, maintenance and sustainability of irrigation in Rwanda

http://3ieimpact.org/en/evidence/impact-evaluations/details/6263/

3ie study on the effects of entrepreneurship edutainment in Egypt

http://www.3ieimpact.org/en/evidence/impact-evaluations/details/2902/

Ajoutez un commentaire

Soyez le premier à faire un commentaire